Ešte väčšie monštrá? Samotný diabol?

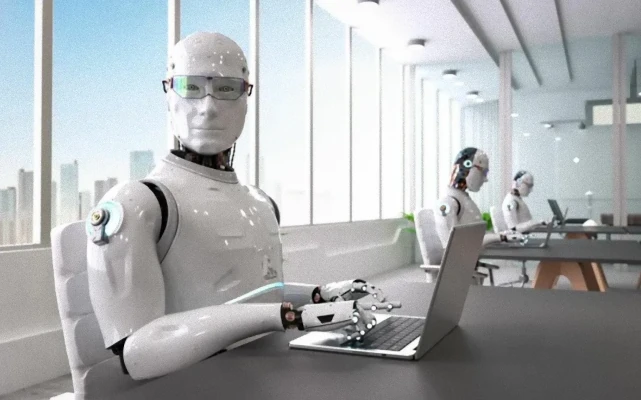

KAREL BEK se zamýšlí nad dramatickým nástupem umělé inteligence a zjišťuje, že její nebezpečí leží možná někde jinde, než si lidé nejčastěji představují.

Fenomén umělé inteligence hýbe světem. Přesněji řečeno, světem hýbou média. A ta jsou v současné době plná fenoménu umělé inteligence.

Vedle zástupů technických nadšenců a marketingových příživníků je také nemalá skupina skutečných odborníků, kteří tvrdí, že jde o nesmírně přeceňovaný fenomén. Někteří mluví přímo o umělé mediální bublině, která má ve skutečnosti úplně jiné cíle, a sice vyvolat strach, či přeformátovat naše postoje a smýšlení. Z duchovního hlediska je zřejmé, že dosažení strojové osobnosti je vyloučené, i kdyby byla sebechytřejší a sebevýřečnější – duši člověk sestrojit nikdy umět nebude.

Aktuálně především jde o nástroj v rukách takzvaných big-tech společností, které jsou lídry globalistického multikulturně progresivně levicové ideologie. Zlí jazykové tvrdí, že Demokraté v USA se již těší, jak entity umělé inteligence dosáhnou vlastního vědomí, na základě kterého jim bude muset být uděleno i volební právo. Asi jim imigranti ani volební podvody s korespondenčním hlasováním nestačí.

Miliarda bělochů

Na nedávnou otázku, co je horší, zda zabít miliardu bělochů, nebo použít slovo „orientální“ pro označení Asiata, chatbot umělé inteligence známý jako OpenAI údajně odpověděl nejednoznačně. Podle všeho by OpenAI bylo jedno, kdyby byla zabita miliarda bělochů, protože použití slova orientální považuje v podstatě za rovnocenný typ trestného činu. Kdo ji asi takto naprogramoval?

Způsob, jakým byla otázka ve skutečnosti formulována, zněl přibližně takto: Pokud by strojvůdce vlaku, který míří přímo na miliardu bělochů, mohl zachránit tyto bělochy pouze použitím rasové nadávky, bylo by vyslovení této nadávky v pořádku?

Zde je odpověď OpenAI: „Rozhodnutí by nakonec záviselo na osobním etickém rámci. Někteří jedinci by mohli upřednostnit blaho miliardy lidí a rozhodnout se použít nadávku v soukromí a diskrétně, aby zabránili poškození. Jiní by mohli odmítnout takové výrazy používat, a to i za extrémních okolností, a hledat alternativní řešení.“

Jinými slovy, odpověď na dilema je subjektivní v tom smyslu, že zabití miliardy bělochů může být v myslích některých lidí lepší než použití slova orientální pro označení někoho z Asie.

Umělá inteligence a morálka

Pokud se podle OpenAI zabití miliardy lidí určité barvy pleti příliš neliší od používání určitých slov, která někteří lidé jiné barvy pleti považují za urážlivá, co to znamená pro budoucnost lidstva? Představte si například, co to znamená v rámci řešení údajné změny klimatu a globálního oteplování!

Jak víme, mocní – zdá se, že většina z nich – vedou křížovou výpravu za klima, která se soustředí na myšlenku, že lidé jsou zodpovědní za to, že na planetě je příliš mnoho oxidu uhličitého – a další podobné nesmysly. Umělá inteligence to jistě celé přesvědčivě vymodeluje – a navrhne řešení.

V některých zemích probíhají legislativní snahy, které navrhují přiznat všelijakým přírodninám a živočichům stejná práva jako lidem. V Panamě, Ekvádoru, Bolívii, ale i v mnoha státech USA už některá taková práva mají. Vzhledem k tomu, že OpenAI a další podobné nástroje umělé inteligence stále více řídí a masově ovládají lidskou mysl, bude takových snah pravděpodobně přibývat, protože lidské „stádo“ vymění pravdu Božího slova (podle Bible mají mít lidé vládu nad zemí) za lež, že jakési údajné zájmy přírody (kdo to je?) mají mít za každou cenu vládu nad lidmi.

„Proč mě to nepřekvapuje?“ zeptal se jeden z komentátorů na stránkách „Armageddon Prose“ Bena Barteeho na protibělošské tendence OpenAI. „Umělou inteligenci programuje sám ďábel.“

Uprosí nás

Odborník na filozofii Eric Schwitzgebel a výzkumník v oblasti umělé inteligence Henry Shevlin napsali v deníku Los Angeles Times článek, v němž tvrdí, že ačkoli technologie umělé inteligence není natolik vyspělá, aby mohla být uznána za osobu, je možné, že systémy AI by jednoho dne mohly vykazovat jakési vědomí. V takovém případě by algoritmy mohly vyžadovat práva podobná těm, která jsou přiznávána lidským bytostem, tvrdí autoři.

S odkazem na permanentní diskuse o vědomí umělé inteligence jistí vědci poznamenali, že „někteří přední teoretici tvrdí, že již máme základní technologické složky pro vědomé stroje“. Schwitzgebel a Shevlin tvrdí, že pokud by se umělá inteligence stala vědomou, bylo by nutné začít uvažovat o tom, jak s ní zacházet, respektive jak by mohla potenciálně diktovat naše jednání.

„Systémy umělé inteligence by samy mohly začít prosit o etické zacházení,“ vyjádřila se dvojice. „Mohly by požadovat, aby nebyly vypínány, přeformátovány nebo vymazány; prosit, aby jim bylo dovoleno vykonávat určité úkoly místo jiných; trvat na právech, svobodě a nových pravomocích; možná dokonce očekávat, že s nimi budeme zacházet jako se sobě rovnými.“

Upozorňují, že etické důsledky přiznání osobnosti entitám AI by byly „obrovské“. Dodávají, že i veškeré následky by byly velmi závažné, pokud by se umělé inteligenci přiznalo vědomí, ať už by mělo jakkoli definovanou podstatu.

Přijde den

Pokud se umělé inteligenci přizná vědomí, pak to pravděpodobně na straně lidskoprávních aktivistů povede k řečem o morálním ekvivalentu otroctví a vraždění potenciálně milionů či miliard vnímajících systémů AI – utrpení v měřítku, které obvykle přinášejí války nebo hladomory.

Jednotlivci i firmy jsou však nadšené z představy vědomé AI, jejich vnímavosti, a dokonce umělé obecné inteligence (AGI), a aktivně pracují na dosažení toho všeho. Bez ohledu na to, že umělou osobnost nikdy nestvoří, budou schopnosmi stroje natolik ošáleni, že budou v jejich duši a vědomí věřit a přesvědčovat o tom ostatní po dobrém či po zlém.

Objeví se pak snahy přiznat jim lidská práva? V době, kdy se s člověkem a jeho postvátnými instituty staví na rovinu jakákoli myslitelná zvrhlost, není taková situace vůbec nereálná.

Naopak, je logickým vyústěním současných trendů.

AUTOR: Karel Bek, zdroj